Блог

Избавляем сайт от некачественного контента

Страницы с контентом низкого качества есть на сайтах у большинства компаний. Несмотря на то, что эта информация кажется безобидной, именно она может испортить рейтинг целого сайта. Поэтому не стоит откладывать утилизацию некачественного контента.

Что такое страницы с низким качеством наполнения?

«Плохой» контент – это:

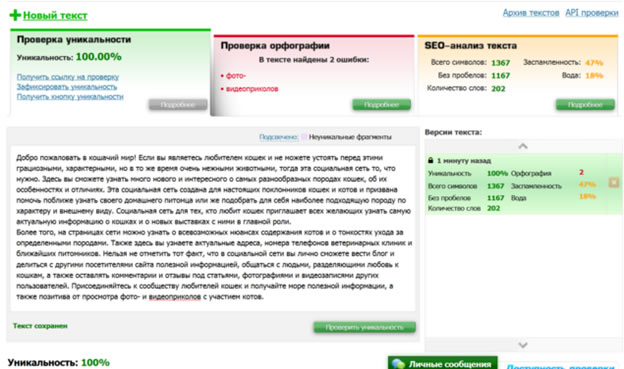

- Страницы с низким уровнем уникальности информации. Проверить уникальность текста можно сервисом text.ru, например.

- Страницы с низким количеством контента. Описания для карточек товара лучше делать от 300 знаков, а объем информационных статей от 1500 знаков и до бесконечности. Главным критерием остается качество. Информация должна быть представлена полностью и быть интересной.

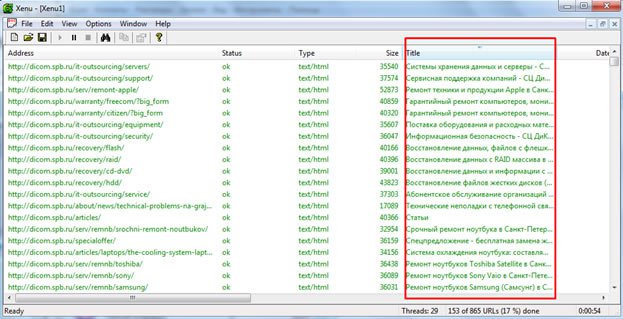

- Дубли страниц. На сайте не должно быть страниц с одним и тем же содержанием, но доступным по разным URL-адресам. Так же у всех страниц должны различаться meta-теги и заголовки. Проверить их уникальность можно программой Xenu.

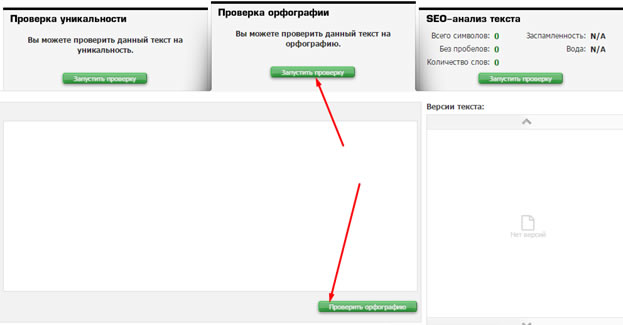

- Отдельные ошибки в верстке или оформлении. Определяются либо визуально, либо при помощи сервиса: http://text.ru/spelling или «старый добрый» Word.

Если объем страниц с низким качеством будет превышать допустимый уровень, то поисковые системы Яндекс, Google, Mail и другие заметят это. В итоге, пострадает и доверие к сайту («trust site» – можно проверить на сервисе http://xtool.ru/), и, как следствие, сам сайт.

Данные страницы несут опасность также со стороны индексации. Поисковому роботу придется перебрать большое количество низкокачественного контента, прежде чем он, наконец, сможет проиндексировать нужные страницы с качественной и полезной информацией.

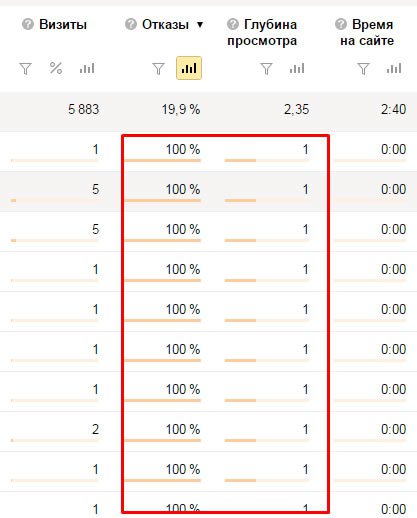

Наличие «плохих» страниц повлечет за собой отток пользователей. Даже при наличии нормальной конверсии и высокого трафика, пользователи, заходя на такую страницу, покинут ваш сайт и могут больше не вернуться, да и в закладки своего браузера врядли занесут.

Почему стоит искать «некачественные» страницы?

При запуске сайта с большим объемом страниц низкого качества, его видят поисковые системы: Яндекс, Google и прочие. Они видят, если пользователи быстро уходят со страницы. Либо заканчивают на ней свое пребывание на сайте (если это не страница корзины или контактов). Поисковые роботы, анализируя поведенческий фактор сайта в целом оценивают также другие показатели (отказы, глубина просмотра, время на сайте, добавление сайта в закладки, количество нажатий кнопок «Поделиться»). Поисковики анализируют динамику домена в целом, а не отдельных страниц. Значит, найдя много «плохих» страниц с плохими показателями - может понизить trast сайта и, как следствие, его позиции, трафик, а значит и выручка тоже упадет.

Принципы ранжирования:

- проверка ссылок на определенную страницу (релевантность, авторитетность). Можно проверить программой PageWeight

- проверка общего количества ссылок на домен. Можно узнать в вэбмастере Яндекса, вэбмастере Google, на сервисе Linkpad.

- ключи, исходя от расположении в html коде;

- трафик на сайте и доверие к сайту.

Ищем низкокачественный контент

Самое простое решение проблемы со страницами плохого качества – использование Google Analytics, Яндекс Метирка, а также иных систем для веб-аналитики.

Варианты для решения проблемы:

- Любая метрика может быть использована в качестве фильтра страниц по проценту отказа и времени визита. При установке нужного критерия, к примеру, страницы, у которых процент отказа под 100%, мы получаем нужные страницы.

- Установка среднего времени на сайте, средний показатель отказов и минимум. Затем выбираем половину результатов, у которых низкие результаты по заданным параметрам. Данный процесс обнаруживает «плохие» страницы, а также страницы с дублирующимся контентом.

Стоит заметить, что не все страницы с низкими показателями, считаются опасными. Случается и так, что информативная страница не несет большой объем, но это не мешает ей выполнять свою роль.

Итог

Наличие страниц с неуникальным контентом, страниц с некачественной версткой, дублей, может понизить сайт в выдаче поисковых систем. Следовательно, уменьшится трафик на сайт, что, в свою очередь, приведет к уменьшению продаж товаров или услуг компании в интернете. Как видите, такая «мелочь» может негативно отразиться на показателях успешности вашего бизнеса, а работа по устранению подобных страниц достаточно монотонная и требует определенной квалификации. Наши специалисты это могут и умеют. Доверьтесь профессионалам, и ваша проблема будет решена.

Поделиться

Заполняя данную форму вы принимаете условия cоглашения об

использовании

сайта, в том числе в части обработки и использования персональных

данных, а так же политики конфиденциальности